|

||

|

Senior Member

加入日期: Mar 2004 您的住址: 長沙

文章: 1,365

|

AMD第一款Vega核心MI25加速卡發佈:搭載16GB HBM2 VRAM

消息來源

和NVIDIA年初揭曉Pascal時幾乎一樣,AMD公開了基於全新一代Vega核心的首發產品,服務於高性能運算的加速產品Radeon instinct MI25。  這款加速卡主力服務於深度學習領域,16位元半精度浮點25TFLOPs,32位元單精度浮點12.5 TFLOPs,熱設計功耗低於300W。   也就是說,比起Pascal架構的Tesla P100,AMD的新品在浮點運算、功耗上都要略勝那麼一點點,考慮到這是後發款, 大家感覺失望還是意料之中? 其他規格方面,VRAM是HBM2,容量16GB,頻寬512GB/s,預計是2048-bit 1000 MHz(2 HBM2堆疊)或 4096-bit 500MHz(4 HBM2堆疊),相較Tesla P100,MI25的HBM2代VRAM有著更好的暫存記憶體和主控方案。   性能方面,AMD以自家主推的MIOpen做了對比,顯示比NV的並行計算方案優秀,同時深度學習指標,連MI8(8.2TFLOPs)都 超越了新TITAN X(大於10T)。 MIOpen顧名思義是一個開源項目,NVIDIA也有一套自己的cuDNN對標,只是AMD為啥不拿Tesla P100來對比? 基於MI25,SuperMicro已經拿出了一套集群計算方案,最小100 TFLOP(4張Instinct MI25), 最高3 PetaFlops(120張Instinct MI25),預計明年上半年上市。 AMD也在峰會現場的一台主機裡展示了一張Vega遊戲卡以4K解析度、Vulkan API下跑《毀滅戰士4》。 這張遊戲卡搭載了8GB HBM2 VRAM,而且輸出遊戲竟然透過的是miniDP接口。 遊戲得分978140分,4K平均落在66FPS,非複雜場景能沖上70+。   VDZ對比了一些OC非公版的GTX 1080在4K下的成績

__________________

Which one do you like to choose?

此文章於 2016-12-13 04:50 PM 被 ChungWhaCanon 編輯. |

|||||||

|

|

|

Major Member

加入日期: Jan 2013 您的住址: 天堂與天空之間

文章: 215

|

借問一下

深度學習是什麼東西   寫程式用??

__________________

|

||

|

|

|

*停權中*

加入日期: Aug 2015

文章: 48

|

引用:

重點擺在16位元半精度浮點,32位元單精浮點。 怎麼看都像挖礦卡? 之前一堆人買AMD顯示卡來挖, AMD 這代乾脆出礦卡賣嗎? 剛 google 了一下 [深度學習] 好像是人工智慧的一項 Nvidia 網站深度學習的介紹 此文章於 2016-12-13 05:35 PM 被 marumi 編輯. |

|

|

|

|

Power Member

加入日期: Aug 2002 您的住址: PCDVD 02梯

文章: 578

|

引用:

車商A: 我們家載卡多比對方的雙人轎跑載貨量遠高出2倍!! 車商N: .....

__________________

^^A 請多指教~ |

|

|

|

|

*停權中*

加入日期: Dec 2004

文章: 593

|

至少人工類神經網路這一塊 NV已不能再賺飽飽了 AMD也拿出相對應的產品出來了 有競爭才是好事

|

|

|

|

Power Member

加入日期: Nov 2004

文章: 691

|

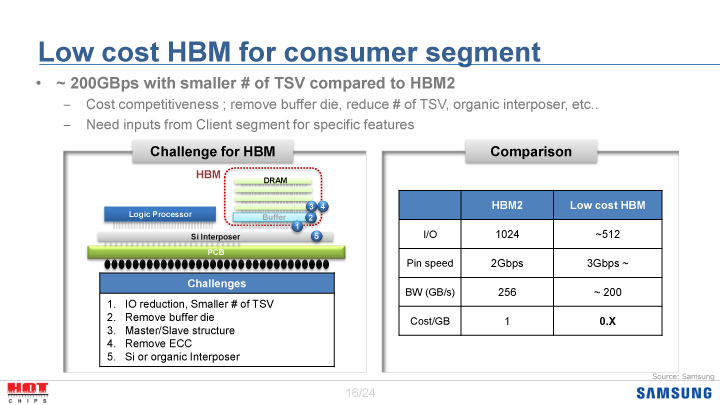

嗯…AMD沒寫HBM2哦

HBM2的規格是 2/4/8-Hi 16ch 256GB/s 以4顆4-Hi 容量16GB 頻寬1TB/s 如果我猜得沒錯 應該是通道數砍半的變種 2-Hi 8ch 128GB/s 4顆構成容量8GB 頻寬512GB/s 成本控制在合理範圍內 |

|

|

|

*停權中*

加入日期: Mar 2011

文章: 1,522

|

引用:

就我手上的Fintech專案 這種精度效果很低,非常低 金融業與HFT要得精確度是這個的三四倍不止 這張卡除了挖礦與打電動,我很懷疑還有其他用途 深度學習要看各家library的要求 但是看spark MLlib的計算要求 ............................恩............................. 我用星爺的圖好了  此文章於 2016-12-19 12:35 AM 被 csshih 編輯. |

|

|

|

|

Power Member

加入日期: Nov 2004

文章: 691

|

引用:

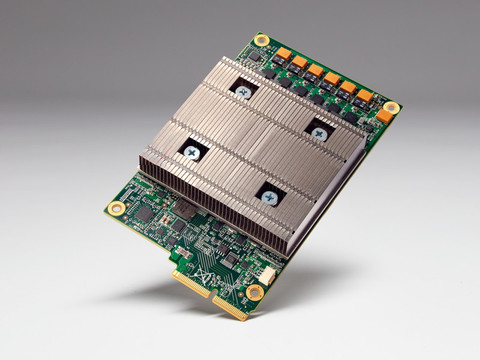

Google的「TensorFlow」也是標榜快速低精度 「Tensor Processing Unit(TPU)」 甚至不是完整的CPU 引用wiki Tensor processing unit (TPU) In May 2016 Google announced its tensor processing unit (TPU), a custom ASIC built specifically for machine learning and tailored for TensorFlow. The TPU is a programmable AI accelerator designed to provide high throughput of low-precision arithmetic (e.g., 8-bit), and oriented toward using or running models rather than training them. Google announced they had been running TPUs inside their data centers for more than a year, and have found them to deliver an order of magnitude better-optimized performance per watt for machine learning.[12] |

|

|

|

|

Power Member

加入日期: Nov 2004

文章: 691

|

以機械學習來說 精度不重要

Google的「TensorFlow」甚至是8-bit |

|

|

|

Power Member

加入日期: Nov 2004

文章: 691

|

應該類似三不爽提出的 low cost HBM 不過通道數砍半不在HBM標準規範內 AMD在記憶體描述用了個模糊的字眼 |

|

|